生成式學習的兩種策略:要各個擊破,還是要一次到位

生成式學習的兩種策略:要各個擊破,還是要一次到位

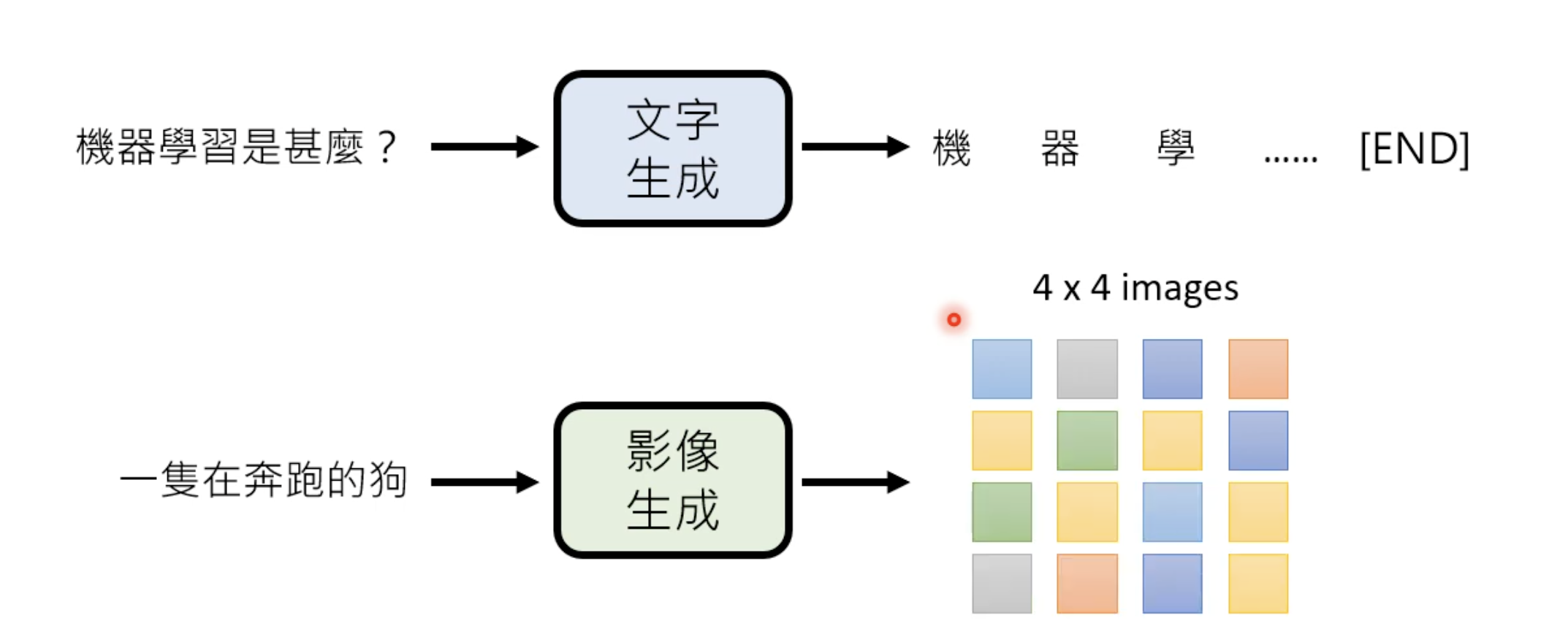

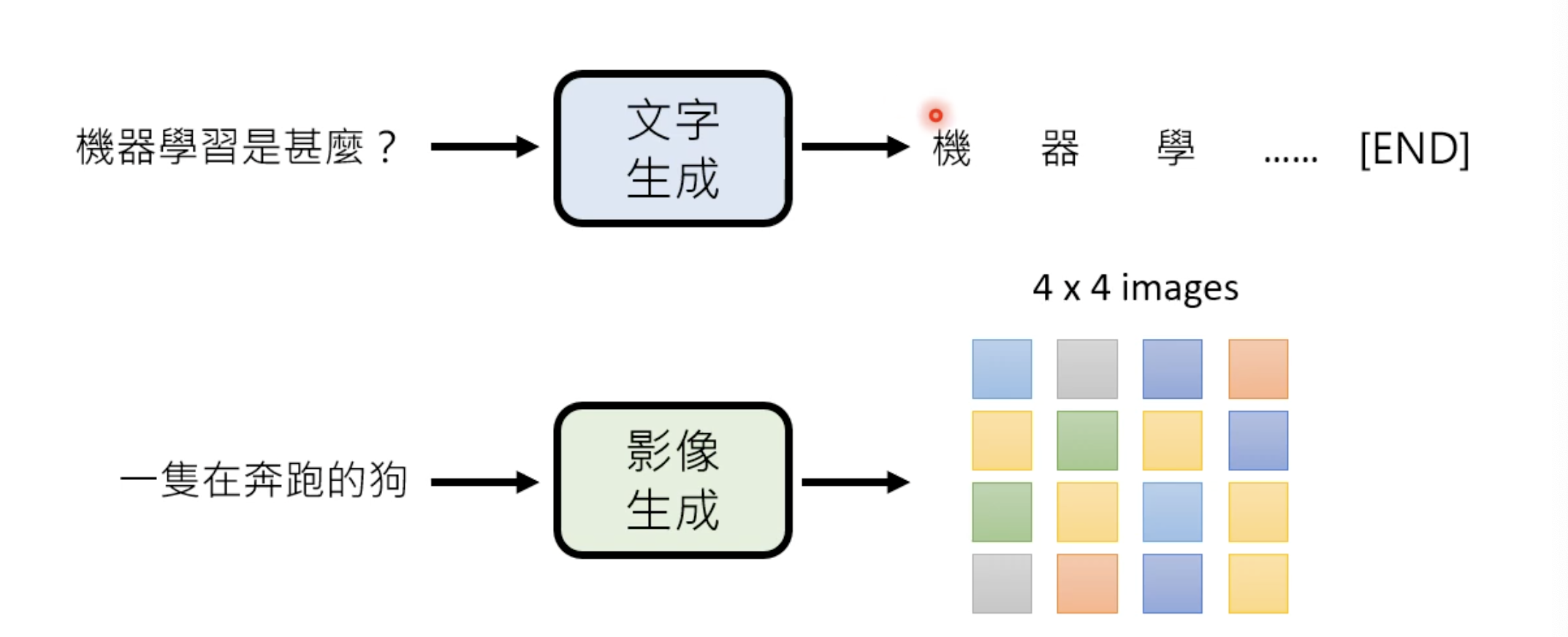

生成式AI—生成有结构的复杂物件,如文句、影像、语音

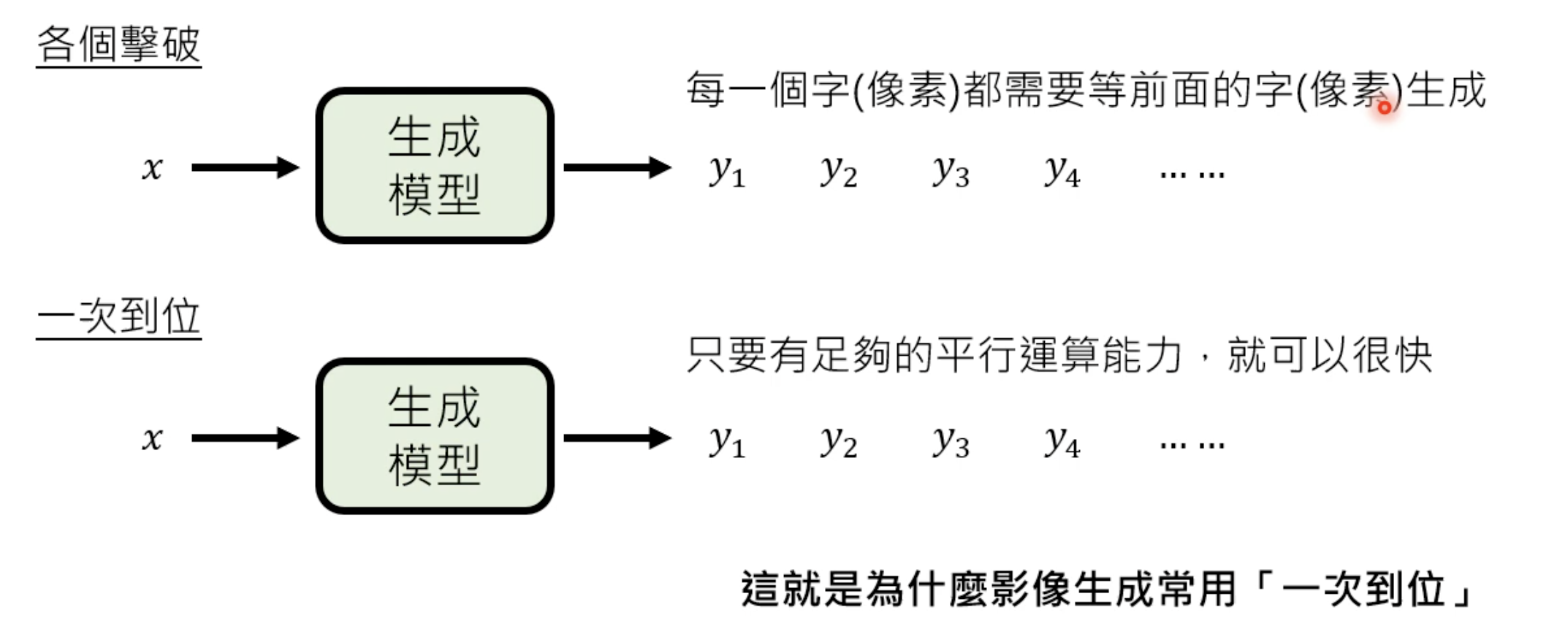

策略1:各个击破

Autoregressive(AR) Model

产生代表结束的符号时停下来

策略2:一次到位

Non-autoregressive(NAR) Model

怎么知道结束?

法一:固定输出长度,碰到[END],后面直接丢掉

法二:先输出一个数字,再生成这么多个字

各个击破像是“串行化”,一次到位像是“并行化”

各个击破的生成品质通常比较好,因为在产生下一个token的时候会受到上一个token的影响,可能会产生一些看起来很奇怪的答案

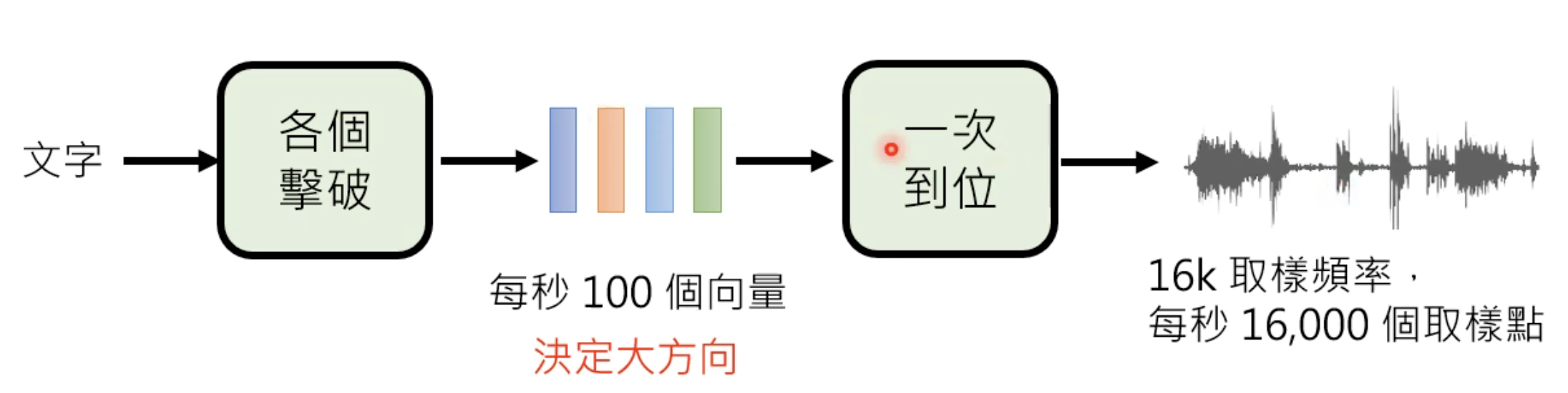

语音合成领域

也可以使用“N次到位”,也就是多次反复进行一次到位的操作,比如先产生模糊的图片,然后再越来越清楚

Diffusion Model

This post is licensed under CC BY 4.0 by the author.